AI Act: bist du bereit? Alle To-dos im Überblick

Künstliche Intelligenz (KI) ist längst ein zentraler Treiber der digitalen Transformation. Ob in der Industrie, im Gesundheitswesen oder im Finanzsektor – KI-Technologien fördern Innovationen und eröffnen neue Geschäftspotenziale. Um diesen Fortschritt verantwortungsvoll zu gestalten, hat die Europäische Union mit dem Artificial Intelligence Act (AI Act) einen umfassenden Rechtsrahmen geschaffen. Ziel ist es, vertrauenswürdige KI-Systeme zu fördern und gleichzeitig Risiken zu minimieren.

Die Verordnung basiert auf einem risikobasierten Ansatz und ist seit dem 1. August 2024 in Kraft. Nun sind die EU-Mitgliedsstaaten gefordert, den AI Act in nationales Recht zu überführen. Die konkrete Ausgestaltung der Anforderungen befindet sich vielerorts noch in der Umsetzung.

Unternehmen, die KI entwickeln oder einsetzen, sollten sich dennoch frühzeitig mit den neuen Regelungen vertraut machen. Denn die Anforderungen sind komplex und betreffen zahlreiche Bereiche – von Transparenzpflichten über Risikobewertungen bis hin zu Dokumentationsstandards. Eine proaktive Auseinandersetzung mit dem AI Act ist entscheidend, um rechtzeitig compliant zu sein und Innovationspotenziale weiterhin sicher nutzen zu können.

Für wen gilt der AI Act und welche Rolle nimmt dein Unternehmen dabei ein?

Der AI Act gilt unabhängig vom Standort eines Unternehmens – entscheidend ist, ob ein KI-System:

- in der EU auf den Markt gebracht wird oder

- Auswirkungen auf Personen in der EU hat

Von Entwickler über Importeure bis hin zu Betreibern, der AI Act nimmt alle Akteure entlang der KI-Wertschöpfungskette in die Pflicht.

Unternehmen können folgende Rollen einnehmen:

Anbieter

Entwickeln KI-Systeme und stellen diese zur Nutzung zur Verfügung oder bringen sie unter eigenem Namen bzw. Handelsmarke auf den Markt

Betreiber

Setzen KI-Systeme geschäftlich ein, ohne sie selbst weiterzuentwickeln oder unter eigener Marke anzubieten.

Produkthersteller

Bieten oder vertreiben KI-Anwendungen unter eigenem Namen bzw. Marke in der EU als Produkt oder Bestandteil eines Produktes an.

Importeure

KI-Systeme aus dem Ausland werden auf den europäischen Binnenmarkt gebracht.

Händler

KI-Systeme werden an Endnutzer oder andere Unternehmen verkauft.

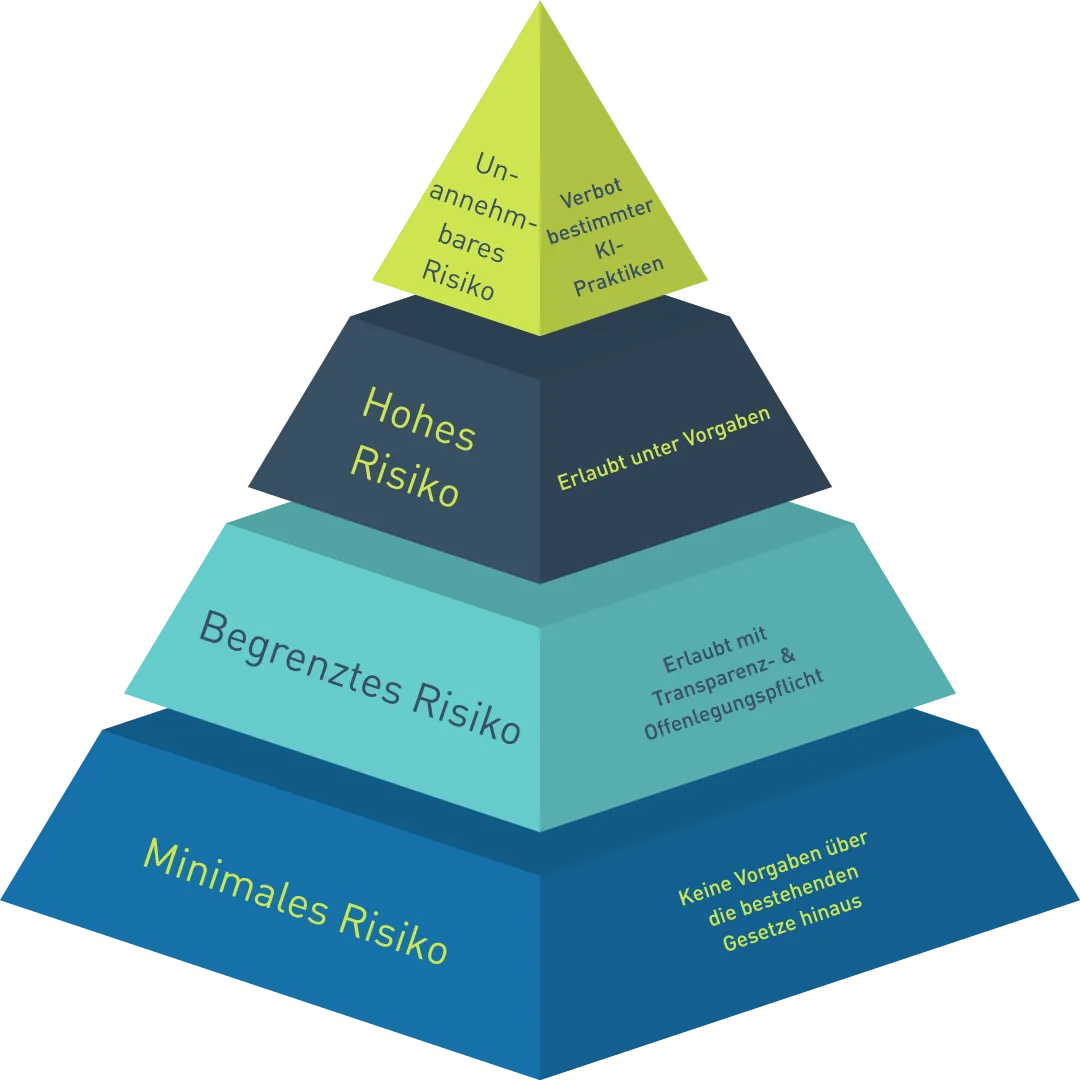

Welche Risiken sind mit dem Einsatz der KI-Systeme verbunden?

Für die verschiedensten Arten von KI-Systemen gibt der AI Act unterschiedliche Anforderungen vor. Diese Anforderungen orientieren sich an dem jeweiligen Risikopotenzial. Grundsätzlich gilt: Je höher das Risiko, desto strenger die Anforderungen.

Jedes Unternehmen muss seine KI-Systeme nach den klassifizierten Risiken einordnen, um entsprechende Maßnahmen umsetzen zu können. Das Risiko wird in folgende Risikogruppen unterteilt:

Unannehmbares Risiko

Verbotene KI-Praktiken laut Artikel 5 des AI Act

Seit dem Februar 2025 sind bestimmte KI-Anwendungen in der EU verboten, da sie ein unannehmbares Risiko für Grundrechte, Sicherheit und EU-Werte darstellen.

Dazu zählen:

- Manipulative Techniken

KI-Systeme, die Menschen durch unterschwellige oder täuschende Methoden beeinflussen und ihre Entscheidungsfreiheit erheblich einschränken. - Ausnutzung schutzbedürftiger Gruppen

Systeme, die gezielt Schwächen von Kindern, älteren Menschen, Menschen mit Behinderung oder in prekären Lebenslagen ausnutzen, um deren Verhalten zu beeinflussen. - Social Scoring

Bewertung von Personen basierend auf ihrem sozialen Verhalten oder persönlichen Eigenschaften, was zu ungerechtfertigter Benachteiligung führen kann – z. B.: durch Vermieter oder Behörden. - Biometrische Echtzeit-Fernidentifizierung

Einsatz von Gesichtserkennung in öffentlichen Räumen in Echtzeit – mit Ausnahmen für Strafverfolgung bei schweren Straftaten, Terrorabwehr oder Vermisstensuche. - Biometrische Kategorisierung

Ableitung sensibler Merkmale wie ethnische Herkunft, Religion, politische Meinung oder sexuelle Orientierung – mit engen Ausnahmen für Strafverfolgung. - Emotionserkennung am Arbeitsplatz oder in Bildungseinrichtungen

Verboten ohne ausdrückliche Zustimmung – erlaubt nur bei medizinischen oder sicherheitsrelevanten Zwecken.

Hohes Risiko

- Hochrisiko-KI-Systeme im AI Act

Die meisten Regelungen des AI Acts betreffen sogenannte Hochrisiko-KI-Systeme, da sie in sensiblen Bereichen eingesetzt werden und bei Fehlfunktionen erhebliche Auswirkungen haben können – z. B. im autonomen Fahren. Für diese Systeme gelten strenge Anforderungen.

Wann gilt ein KI-System als hochriskant?

Ein System fällt unter die Hochrisiko-Kategorie, wenn es:

- Anhang I: Teil eines Produkts ist, das unter bestehende EU-Produktregulierungen fällt (z. B.: Spielzeuge, Maschinen, Fahrzeuge) und eine Konformitätsbewertung benötigt.

- Anhang III: In einem der folgenden acht sensiblen Anwendungsbereiche eingesetzt wird: Biometrische Fernidentifizierung(z.B.: Gesichtserkennung)

Kritische Infrastrukturen(z.B.: Energieversorgung, Verkehr)

Bildung(z.B.: Bewertung von Prüfungen oder Zugang zu Bildung)

Beschäftigung & Personalmanagement(z.B.: Bewerbungsverfahren, Beförderungen)

Zugang zu wesentlichen Dienstleistungen(z.B.: Kredite, Versicherungen, Notfalldienste)

Strafverfolgung(z.B.: Lügendetektoren, Beweismittelbewertung)

Migration & Grenzkontrollen(z.B.: Asylanträge, Identitätsprüfung)

Justiz & demokratische Prozesse(z.B.: Unterstützung von Gerichten, Einfluss auf Wahlen)

Begrenztes Risiko

- Transparenzpflichten für KI-Systeme mit geringem Risiko

Auch KI-Systeme mit geringem Risiko, wie z. B. Chatbots, unterliegen bestimmten Anforderungen:

- Kennzeichnungspflicht: Nutzer müssen klar darüber informiert werden, dass sie mit einer KI interagieren oder dass Inhalte (z. B.: Bilder, Texte, Videos) künstlich erzeugt wurden.

- Deepfakes: Inhalte, die täuschend echt wirken und potenziell manipulativ oder irreführend sind, müssen deutlich als KI-generiert gekennzeichnet werden – sowohl von Anbietern als auch von Betreibern.

- Systemisches Risiko: Für besonders leistungsstarke KI-Modelle gelten zusätzliche, abgestufte Vorschriften, da sie ein höheres systemisches Risiko darstellen können.

Geringes Risiko

Dazu zählen KI-Systeme mit geringem Risiko, wie etwa Spamfilter. Für diese Anwendungen bestehen keine verpflichtenden Anforderungen. Unternehmen wird jedoch empfohlen, freiwillig einen Verhaltenskodex für den verantwortungsvollen Einsatz von KI zu entwickeln und umzusetzen.

Der AI Act sieht vor, dass die Europäische Kommission innerhalb von zwölf Monaten nach Inkrafttreten der Verordnung einen solchen freiwilligen KI-Verhaltenskodex zur Unterstützung bereitstellt.

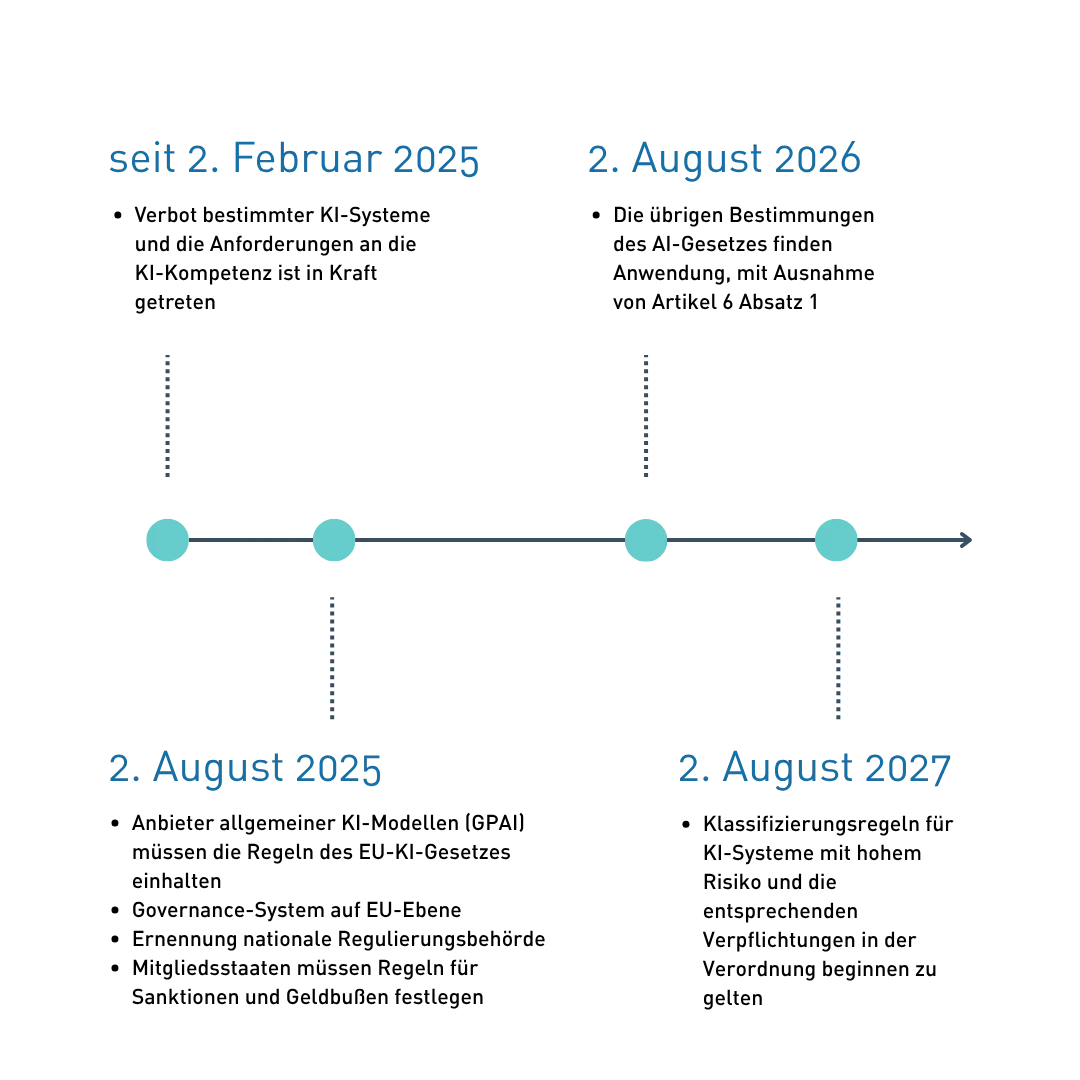

Welche Umsetzungsfristen müssen Unternehmen kennen?

Um die Anforderungen des AI Acts schrittweise einzuführen, hat die EU einen klaren Zeitplan für die Umsetzung der KI-Gesetze festgelegt. Mit unserer Übersicht zu allen wichtigen Umsetzungsfristen bis 2026 seid ihr vorbereitet und verpasst keine Fristen mehr.